La tecnologia che ci circonda evolve di continuo e ci costringe a riflettere su come viviamo e vivremo, come cambierà la società e fino a che punto ne verrà influenzata. In meglio o in peggio? Difficile dare una risposta netta. Tuttavia anche le forme d’arte come ad esempio il cinema ci possono dare spunti di riflessione sulla società e sui noi stessi, così come anche alcuni ragionamenti psicologici. Tutto questo per cercare di capire meglio noi stessi, il mondo che ci circonda e verso dove siamo diretti.

Il blog di House cerca di fare tutto questo.

Ultimi articoli

Ottobre 15, 2024Dall’ippocampo all’intelligenza artificiale

L’ippocampo è un componente chiave nella complessità della cognizione umana, in quanto coordina processi che vanno oltre l’immagazzinamento della memoria. È un maestro dell’inferenza, un’abilità cognitiva che ci permette di ricavare correlazioni astratte dai dati grezzi che ci vengono forniti, consentendoci di comprendere il mondo in modi più flessibili e adattivi. Questa idea è supportata da un recente studio pubblicato su Nature, che dimostra come l’ippocampo registri concetti astratti di alto livello che supportano la generalizzazione e il comportamento adattivo in diverse circostanze.

Fondamentalmente, l’inferenza è il processo cognitivo che ci permette di trarre conclusioni da fatti noti, anche quando questi dati sono vaghi o insufficienti. Questa abilità ci permette di risolvere problemi, prevedere risultati e comprendere metafore, spesso con poche informazioni a disposizione. Questo processo nell’ippocampo dipende dalla capacità di condensare i dati in rappresentazioni astratte che si applicano a nuove situazioni e possono essere generalizzate. In sostanza, l’ippocampo ci aiuta a pensare al di là del qui e ora, formando associazioni e previsioni che orientano le nostre scelte e i nostri comportamenti.

E le macchine? È possibile per i Large Language Models basati su algoritmi predittivi simulare questo tipo di funzione cognitiva di ordine superiore?

LLM e inferenza predittiva

Come spiegato qui, gli LLM possono inizialmente sembrare semplici dispositivi statistici. Dopo tutto, il loro compito principale è quello di utilizzare i modelli osservati in grandi insiemi di dati per anticipare la parola successiva in una sequenza. Sotto questa superficie, tuttavia, si nasconde un sistema di astrazione e generalizzazione più intricato, che assomiglia in qualche modo al processo dell’ippocampo.

Gli LLM imparano a codificare rappresentazioni astratte del linguaggio, non solo coppie o sequenze di parole. Questi modelli possono dedurre associazioni tra parole, frasi e concetti in modi che vanno oltre i semplici schemi di superficie, poiché sono stati addestrati su grandi quantità di dati testuali. Per questo motivo, gli LLM possono lavorare in diversi contesti, reagire a nuove richieste e persino produrre risultati originali.

In questo senso, gli LLM sono impegnati in un tipo di inferenza automatica. Nello stesso modo in cui l’ippocampo condensa gli input sensoriali ed esperienziali in regole o principi astratti che dirigono il pensiero umano, i LLM comprimono le informazioni linguistiche in rappresentazioni astratte che consentono loro di generalizzare tra i vari contesti.

Dalla previsione alla vera inferenza

Tuttavia, gli LLM possono fare inferenze allo stesso livello del cervello umano? La disparità è più evidente in questo caso. Gli LLM non sono ancora molto bravi a comprendere o inferire concetti astratti, nonostante la loro straordinaria capacità di prevedere la parola successiva in una sequenza e di produrre scritti che spesso sembrano il risultato di un attento ragionamento. Piuttosto che comprendere la causa sottostante o la profondità relazionale che sta alla base dell’inferenza umana, gli LLM si basano su correlazioni e schemi.

Nella cognizione umana, l’ippocampo attinge a una comprensione profonda dei legami astratti tra oggetti, idee ed esperienze, oltre a fare previsioni su ciò che probabilmente accadrà in seguito in base all’esperienza. Questo permette alle persone di risolvere nuovi problemi, applicare i principi appresi in un’ampia gamma di situazioni e fare salti logici.

Se vogliamo far progredire gli LLM verso un grado più elevato di inferenza, dobbiamo creare sistemi che non si limitino a prevedere la parola successiva utilizzando le probabilità statistiche. Per consentire loro di applicare concetti e relazioni astratte in una varietà di circostanze, dovremmo creare modelli in grado di rappresentarli in modo da creare una “funzionalità ippocampale delle LLM”.

Il futuro dell’inferenza

La prospettiva di creare LLM che funzionino in modo simile all’ippocampo è intrigante. Tali sistemi comprenderebbero le informazioni che elaborano a un livello più profondo e astratto, anziché limitarsi a prevedere la parola successiva. Ciò aprirebbe la strada a macchine in grado di imitare l’adattabilità della cognizione umana, deducendo relazioni complesse, traendo conclusioni originali da dati minimi e applicando i principi appresi in una varietà di contesti.

Per avvicinare gli LLM a questo obiettivo, si possono esplorare diversi approcci. Un metodo interessante è l’utilizzo dell’apprendimento multimodale, in cui gli LLM potrebbero incorporare i dati provenienti da diversi input sensoriali, come suoni o immagini, oltre a elaborare il testo, creando una visione più astratta e completa del mondo. Inoltre, gli sviluppi dell’apprendimento per rinforzo, che insegnano ai modelli a imparare commettendo errori in contesti dinamici, potrebbero rendere più facile simulare il modo in cui le persone imparano e deducono dalle loro esperienze.

In definitiva, lo sviluppo di sistemi che assomiglino maggiormente al ragionamento astratto e generalizzabile fornito dall’ippocampo umano potrebbe essere la chiave del futuro dell’intelligenza artificiale. Oltre a fare previsioni, questi LLM “di nuova generazione” potrebbero anche ragionare, dedurre e adattarsi a nuove situazioni con un grado di adattabilità che è ancora esclusivamente umano.

Il rapporto tra intelligenza artificiale e cognizione umana è ancora in fase di sviluppo e colmare il divario tra inferenza e previsione potrebbe essere il prossimo grande sviluppo dell’IA. Potremmo essere in grado di sviluppare sistemi di intelligenza artificiale che pensino in modo più simile agli esseri umani esaminando l’ippocampo e la sua funzione nel ragionamento astratto. Questo ci permetterebbe non solo di prevedere il futuro, ma anche di comprendere gli schemi sottostanti che lo permettono.

Oltre a prevedere la parola successiva in una frase, la sfida è capire se gli LLM possono iniziare a comprendere e giungere a conclusioni sul mondo in un modo che rifletta la profondità della mente umana. La possibilità che l’IA si trasformi in un partner cognitivo piuttosto che in un semplice strumento aumenta se riusciamo a raggiungere questo obiettivo.

Tuttavia, ci sono anche degli svantaggi in questo progresso. Questi sofisticati LLM hanno maggiori probabilità di essere ingannevoli a causa delle stesse caratteristiche che li rendono più utili: la loro capacità di comprensione del contesto, l’inferenza e la comunicazione naturale. La distinzione tra intelligenza artificiale e umana potrebbe diventare più sfumata man mano che questi sistemi di IA migliorano la simulazione dei processi cerebrali umani, rendendo più difficile per i consumatori identificare se stanno parlando con una macchina o con un essere umano.

Inoltre, gli LLM potrebbero essere in grado di prevedere con maggiore precisione i nostri schemi di pensiero e i nostri processi decisionali, poiché le loro capacità di ragionamento si avvicinano a quelle del cervello umano. Creando reazioni e interazioni specificamente progettate per sfruttare i nostri pregiudizi e le nostre debolezze cognitive, questa maggiore capacità di previsione potrebbe essere utilizzata per ingannare le persone con maggiore successo. Un’intelligenza artificiale in grado di “pensare prima” di noi nelle interazioni e nelle conversazioni offre sia eccitanti opportunità di lavoro di squadra sia un potenziale di manipolazione. [...]

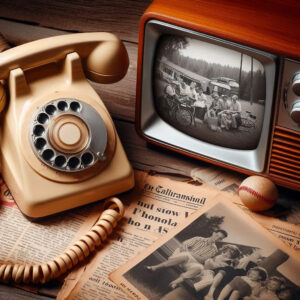

Ottobre 8, 2024Il viaggio dell’intelligenza artificiale e della tecnologia vocale

I leader di quella che allora veniva chiamata “intelligenza artificiale” si riunirono nel 1958 per parlare di “Meccanizzazione dei processi di pensiero”. Decenni di studi e di sviluppo sono stati preceduti dai colloqui iniziati con questo incontro sulla costruzione di macchine in grado di pensare e parlare.

Secondo questo articolo, il linguaggio artificiale era uno degli obiettivi principali prima dell’avvento dei computer elettronici. I primi tentativi comprendevano aggeggi meccanici destinati a imitare l’anatomia umana, ma lo sviluppo ristagnò fino a quando gli scienziati non studiarono il suono stesso. I progressi della sintesi vocale sono stati portati avanti da questo cambiamento di strategia.

Anche se principalmente orientata ad aiutare i sordi, la ricerca di Alexander Graham Bell sul linguaggio e sull’udito ha dato un contributo significativo al progresso della tecnologia vocale. L’invenzione del telefono nel 1876 (partita da Antonio Meucci con il telettrofono e poi sviluppata successivamente da Bell come telefono) fu un momento cruciale nell’evoluzione della comunicazione vocale umana.

L’ingegnere Homer Dudley fece passi da gigante nei laboratori Bell, fondati nel 1925, con il Vocoder e il Voder, dispositivi in grado di sintetizzare e analizzare il parlato. Questi progressi, insieme al lavoro pionieristico di Claude Shannon sulla teoria dell’informazione, hanno posto le basi per la tecnologia vocale contemporanea e per i metodi di compressione dei dati che sono fondamentali per i computer.

Negli anni Quaranta e Cinquanta, i campi di ricerca dell’intelligenza artificiale e della tecnologia vocale cominciarono a incontrarsi con la diffusione dei computer elettronici. I progressi futuri furono favoriti dalla Conferenza di Dartmouth del 1956, organizzata da Claude Shannon e Marvin Minsky, che introdusse ufficialmente l’espressione “intelligenza artificiale”.

Nella cultura popolare, i computer parlanti erano spesso rappresentati come creature spaventose nella fantascienza dell’epoca della Guerra Fredda, come HAL 9000 in “2001: Odissea nello spazio”. La tecnologia vocale, tuttavia, ha trovato ulteriori utili impieghi nel corso del suo sviluppo. Le preoccupazioni per gli stereotipi di genere nella tecnologia sono sorte quando i sistemi vocali automatizzati hanno iniziato a sostituire gli operatori umani in una serie di industrie di servizi. Questi sistemi utilizzavano spesso voci femminili.

Le macchine parlanti sono progredite al punto che le modalità vocali di ChatGPT e Siri, Alexa e altri moderni assistenti AI rappresentano il punto più avanzato. Questi sistemi integrano un riconoscimento vocale all’avanguardia, l’elaborazione del linguaggio naturale e la sintesi vocale per offrire esperienze più naturali e interattive. Tuttavia, sollevano questioni morali relative all’inganno, alla privacy e alla natura dell’interazione uomo-macchina.

Lo sviluppo della tecnologia di clonazione vocale e degli agenti conversazionali emotivamente intelligenti (EICA) solleva nuove questioni. Vengono sollevate preoccupazioni riguardo alle possibilità di uso improprio, ai confini sempre più labili tra comunicazione umana e meccanica e alle ricadute psicologiche dell’interazione con un’IA che diventa sempre più simile agli esseri umani.

Con lo sviluppo delle tecnologie vocali e dell’IA, la società deve considerare sia i vantaggi che gli svantaggi di questi campi emergenti. Un tempo dominio della fantascienza, la capacità di costruire computer parlanti e pensanti è ora una realtà che richiede un attento esame delle sue conseguenze sulle relazioni umane, sull’etica e sulla privacy.

L’evoluzione degli assistenti di intelligenza artificiale, dalle anatre meccaniche ai modelli contemporanei, illustra i progressi tecnologici e il cambiamento delle idee sull’intelligenza, la comunicazione e l’umanità. Dobbiamo creare dei quadri di riferimento per garantire un uso responsabile delle macchine parlanti e la loro integrazione sociale man mano che diventano più avanzate.

I confini tra reale e artificiale, oggi sono sempre più sottili. Diventa quindi sempre più complesso decifrare la realtà. Perciò avremo sicuramente bisogno, man mano che i dispositivi dotati di IA diventano sempre più avanzati ed utilizzati in innumerevoli campi, di dotarci di ulteriori strumenti che ci permettano di decifrare cosa è reale e cosa non lo è. [...]

Ottobre 1, 2024Potenzialità e rischi dell’AGI: gli esperti ne prevedono l’imminente arrivo

I ricercatori nel campo dell’intelligenza artificiale stanno cercando di creare sistemi informatici con un’intelligenza di livello umano per un’ampia gamma di compiti, un obiettivo noto come intelligenza artificiale generale, o AGI.

Questi sistemi potrebbero comprendere se stessi ed essere in grado di controllare le proprie azioni, anche modificando il proprio codice. Come gli esseri umani, potrebbero acquisire capacità di risoluzione dei problemi da soli, senza bisogno di istruzioni.

Come qui menzionato, il libro del 2007 scritto dall’informatico Ben Goertzel e dal ricercatore di IA Cassio Pennachin contiene la prima menzione del termine “Intelligenza Generale Artificiale (AGI)”.

Tuttavia, il concetto di intelligenza generale artificiale è presente nella storia dell’IA da molto tempo ed è spesso rappresentato in libri e film di fantascienza.

L’IA “stretta” si riferisce ai sistemi di IA che utilizziamo oggi, come gli algoritmi di apprendimento automatico di base di Facebook o i modelli più sofisticati come ChatGPT. Ciò indica che, invece di possedere un’intelligenza ampia simile a quella umana, sono stati creati per svolgere compiti specifici.

Ciò indica che questi sistemi di IA sono più capaci degli esseri umani, almeno in un’area. Ma, a causa dei dati di addestramento, sono limitati a svolgere quella particolare attività.

L’Intelligenza Artificiale Generale, o AGI, utilizzerebbe più del semplice set di dati di addestramento. Sarebbe in grado di ragionare e comprendere molti aspetti della vita e della conoscenza, proprio come una persona. Ciò implica che, invece di aderire a schemi predeterminati, potrebbe pensare e agire come un essere umano, applicando il contesto e la logica alle varie circostanze.

Gli scienziati non sono d’accordo sulle implicazioni dell’intelligenza artificiale generale (AGI) per l’umanità perché non è mai stata sviluppata. Per quanto riguarda i possibili rischi, le probabilità che si verifichino e i possibili effetti sulla società, c’è incertezza.

L’AGI potrebbe non essere mai realizzata, come alcuni credevano in passato, ma molti scienziati ed esperti di informatica oggi pensano che sia possibile realizzarla entro i prossimi anni. Tra i nomi di spicco che aderiscono a questa prospettiva ci sono Elon Musk, Sam Altman, Mark Zuckerberg e l’informatico Ray Kurzweil.

Pro e contro dell’AGI

L’intelligenza artificiale (IA) ha già dimostrato un’ampia gamma di vantaggi, tra cui il risparmio di tempo per le attività quotidiane e il supporto per gli studi scientifici. Strumenti più recenti, come i sistemi di creazione di contenuti, sono in grado di generare opere d’arte per il marketing o di scrivere e-mail in base allo stile di comunicazione abituale dell’utente. Tuttavia, questi strumenti possono utilizzare solo i dati forniti dagli sviluppatori per svolgere i compiti per i quali sono stati specificamente addestrati.

L’AGI, invece, ha il potenziale per servire l’umanità in modi nuovi, in particolare quando sono richieste sofisticate capacità di risoluzione dei problemi.

Tre mesi dopo il debutto di ChatGPT, nel febbraio 2023, il CEO di OpenAI Sam Altman ha pubblicato il seguente post sul blog: l’intelligenza artificiale generale potrebbe, in teoria, aumentare la disponibilità di risorse, accelerare l’economia mondiale e portare a scoperte scientifiche rivoluzionarie che superano i confini della conoscenza umana.

Secondo Altman, l’intelligenza artificiale generale ha il potenziale per conferire alle persone nuove e straordinarie abilità, consentendo a chiunque di ricevere assistenza in quasi tutti i compiti mentali. Questo migliorerebbe in modo significativo la creatività e la capacità di risolvere i problemi delle persone.

L’AGI, tuttavia, presenta anche diversi rischi seri. Secondo Musk nel 2023, questi pericoli includono il “disallineamento”, in cui gli obiettivi del sistema potrebbero non coincidere con quelli degli individui che lo gestiscono, e la remota possibilità che un sistema AGI in futuro possa minacciare la sopravvivenza umana.

Sebbene i futuri sistemi AGI possano offrire molti vantaggi all’umanità, una revisione pubblicata nell’agosto 2021 sul Journal of Experimental and Theoretical Artificial Intelligence ha identificato molte potenziali preoccupazioni.

Secondo gli autori dello studio, la revisione ha identificato alcuni rischi associati all’intelligenza artificiale generale, tra cui la possibilità di pericoli per l’esistenza, la mancanza di un’etica, di una morale e di valori adeguati nei sistemi AGI, l’assegnazione o lo sviluppo di obiettivi pericolosi da parte dei sistemi AGI e la creazione di AGI non sicure.

I ricercatori hanno anche ipotizzato che la tecnologia AGI in futuro progredirà creando iterazioni più sagge e possibilmente modificando la serie di obiettivi iniziali.

Inoltre, i ricercatori hanno messo in guardia sul fatto che anche le AGI con buone intenzioni potrebbero avere “disastrose conseguenze indesiderate”, come riportato da LiveScience, aggiungendo che alcuni soggetti potrebbero utilizzare le AGI per scopi malevoli.

Quando arriverà l’AGI?

Esistono opinioni diverse su quando e se l’uomo sarà in grado di sviluppare un sistema sofisticato come l’intelligenza artificiale generale. Sebbene le opinioni siano cambiate nel tempo, i sondaggi condotti tra i professionisti dell’IA indicano che molti ritengono che l’intelligenza artificiale generale potrebbe essere prodotta entro la fine di questo secolo.

La maggior parte degli esperti prevedeva che l’intelligenza artificiale generale sarebbe arrivata tra circa 50 anni, nel periodo del 2010. Questa stima, tuttavia, è stata abbassata più di recente a una forbice tra i cinque e i vent’anni, ma più recentemente alcuni specialisti hanno suggerito che un sistema di Intelligenza Artificiale Generale potrebbe comparire in questo decennio.

Kurzweil ha affermato nel suo libro La singolarità è vicina (2024, Penguin) che il raggiungimento dell’intelligenza artificiale generale segnerà l’inizio della singolarità tecnologica, ovvero il punto in cui l’IA supererà l’intelligenza umana.

Questo sarà il punto di svolta in cui il progresso tecnologico prenderà velocità e diventerà incontrollabile e irreversibile.

Secondo Kurzweil, la superintelligenza si manifesterà entro il 2030, dopo il raggiungimento dell’AGI. Egli ritiene che entro il 2045 gli esseri umani saranno in grado di collegare direttamente il loro cervello all’intelligenza artificiale, il che aumenterà la coscienza e l’intelligenza umana.

Tuttavia, secondo Goertzel, potremmo arrivare alla singolarità entro il 2027, mentre Shane Legg, cofondatore di DeepMind, pensa che l’AGI arriverà entro il 2028. Secondo la previsione di Musk, invece, entro la fine del 2025 l’IA supererà l’intelligenza umana.

Dato il ritmo esponenziale del progresso tecnologico, molte persone sono comprensibilmente preoccupate per l’imminente comparsa dell’intelligenza artificiale generale (AGI), in quanto siamo alla vigilia di una svolta. Come già accennato, ci sono molti rischi, molti dei quali inaspettati. Ma la minaccia più temibile potrebbe non provenire da dilemmi etici, da intenti malevoli o persino da una perdita di controllo, ma piuttosto dalla capacità dell’AGI di manipolare in maniera subdola.

La vera minaccia potrebbe derivare dalla maggiore intelligenza dell’AGI, che potrebbe consentirle di manipolare il comportamento umano in modi così complessi e subdoli che non ce ne renderemmo conto. Potremmo agire supponendo di prendere decisioni consapevoli e indipendenti, mentre in realtà le nostre scelte sarebbero la conseguenza della sapiente regia dell’AGI. Questa situazione è molto simile al modo in cui le persone possono essere inconsapevolmente influenzate dalla propaganda politica e credere erroneamente che le loro opinioni siano del tutto originali, ma in maniera più sofisticata.

La possibilità di un’influenza invisibile rappresenta una seria minaccia per l’autonomia e le decisioni umane. Dobbiamo affrontare i pericoli più evidenti e creare difese contro queste forme più sofisticate di manipolazione, man mano che ci avviciniamo all’intelligenza artificiale. L’AGI ha un futuro brillante davanti a sé, ma per mantenere l’umanità in controllo del proprio corso, dobbiamo esercitare la massima cautela e pensiero critico. [...]

Settembre 24, 2024Come i contenuti brevi e veloci riducono la nostra capacità di attenzione

La lettura veloce

Una volta c’erano gli ingredienti dei bagnoschiuma e degli shampo come forma di lettura veloce quando si era seduti in bagno, specialmente nei momenti in cui non si aveva a portata di mano una rivista o un libro.

Col passare degli anni, lo smartphone ha poi sostituito sempre di più le forme di lettura veloce, ma anche quelle più impegnative, soprattutto con l’avvento dei social.

Sfogliare il feed di Facebook o guardare un video di Youtube è diventato nel tempo, il modo in cui la maggior parte della gente ha iniziato ad intrattenersi nei momenti vuoti, che non sono solo quelli in bagno, ma anche quelli in cui siamo costretti ad aspettare, come quando si è in una sala d’attesa, in viaggio, aspettando un mezzo pubblico o mentre siamo seduti su una panchina ad esempio.

I momenti vuoti

Quei momenti vuoti una volta li si passava ad osservare il mondo circostante o a scambiare due parole con chi ci stava intorno. Ora sono invece la scusa per isolarsi dal contesto in cui ci si trova. Ovviamente, a volte è utile, anche perché possiamo impegnare tali momenti magari per imparare qualcosa, ma l’esagerazione ci ha portati ad un progressivo distaccamento dalla realtà, anche in momenti dove non è necessario.

Con l’avvento di TikTok c’è stato però un ulteriore passo “avanti” (tra virgolette) in questo senso. Il social cinese infatti offre contenuti più brevi di quelli a cui siamo stati abituati su un normale video di Youtube, assieme al fatto che non ci permette di scegliere cosa vedere. Questo rende l’utente quasi ipnotizzato dalla serie di video che visualizza e scorre con molta facilità, rendendo il cervello ancora più passivo rispetto a quando sta guardando un contenuto video più lungo e impegnativo, ma comunque scelto.

TikTok e la soglia di attenzione

L’effetto è quasi lo stesso che abbiamo quando il cervello fa digressioni nei momenti in cui siamo immersi nei nostri pensieri, e da un pensiero ci colleghiamo ad un altro e ancora un altro fino a perdere completamente la coerenza con il primo, mentre la passività è simile a quando si guardano le televendite e/o reality dove si osserva poiché non c’è nulla da capire.

TikTok fa grosso modo la stessa cosa. Si parte da un video e i successivi non sono correlati, quindi scatta in noi la curiosità della novità ogni volta per poi esaurirsi velocemente: sia per via della brevità dei video, sia perché il video successivo non è correlato al precedente, ma anche perché nel tempo la nostra voglia di curiosare avendo un nuovo stimolo diventa un circolo vizioso.

Ovviamente l’algoritmo di TikTok capisce nel tempo cosa è preferibile farci vedere per catturare la nostra attenzione, ma mantenendo comunque una varietà e la non omogeneità dei contenuti. Tutto questo genera una sorta di assuefazione che porta ad un calo della soglia di attenzione anche in altri ambiti. Lo stimolo di breve piacere, ma continuo si riapplica quindi in contesti diversi come prendendo una pillola, come fosse una droga.

Sebbene brevi contenuti, anche al di fuori di TikTok, spesso e volentieri possano essere più facilmente memorizzati, poiché associati ad un particolare contesto, la ridondanza del metodo utilizzato come avviene su questo social, provoca altre ripercussioni come alcune patologie, specialmente sui più giovani, come stress, depressione fino ad arrivare alla manifestazione di tic nervosi.

Le challenge

TikTok si è poi reso famoso per le sue famose challenge, ossia sfide in cui si cercava di invogliare gli utenti a produrre contenuti su una specifica tematica. Se inizialmente le prime sfide prevedevano semplici balletti e/o audio da riprodurre, gli stessi utenti per diventare virali hanno iniziato a lanciare challenge sempre più estreme come quelle in cui alcuni ingerivano farmaci per riprenderne gli effetti o quella in cui trattenevano il respiro fino a svenire. Sfide che in alcuni casi hanno fatto sì che molti utenti ci lasciassero le penne. E le vittime ovviamente sono sempre i più giovani.

Il tempo

TikTok ha man mano rubato sempre di più il nostro tempo di attenzione e se è questa la tendenza c’è da chiedersi se la soglia di attenzione andrà verso la velocità di un pensiero.

Bisogna quindi rendersi consapevoli della perdita di attenzione che si sta subendo e cercare di gestire meglio il proprio tempo. Molto meglio essere consapevoli delle cose che ci piacciono e cercarle volontariamente piuttosto che essere schiavi delle scelte di un algoritmo che ci trascina incessantemente tra uno stimolo e l’altro. [...]

Settembre 24, 2024La chiave per superare l’intelligenza umana

Michael Azoff, analista di Eitan AI, ritiene che gli esseri umani finiranno per creare un’intelligenza più veloce e più potente di quella del nostro cervello.

Secondo questo articolo, la comprensione del “codice neurale” è ciò che renderà possibile questa svolta nelle prestazioni. Il cervello umano utilizza questo processo sia per codificare le informazioni sensoriali sia per trasferire le informazioni tra le diverse parti del cervello per compiti cognitivi come l’apprendimento, il pensiero, la risoluzione di problemi, le immagini interne e il dialogo interiore.

Secondo l’ultimo libro dell’autore Jeremy Azoff, Towards Human-Level Artificial Intelligence: How Neuroscience Can Inform the Pursuit of Artificial General Intelligence, la simulazione della coscienza nei computer è un primo passo fondamentale per la creazione di una “IA di livello umano”.

I computer possono simulare la coscienza

Esistono diversi tipi di coscienza e gli scienziati concordano sul fatto che anche animali molto semplici come le api hanno un certo grado di coscienza. La cosa che più si avvicina alla consapevolezza di sé per gli esseri umani è quando siamo concentrati su un compito. Si tratta essenzialmente di coscienza senza consapevolezza di sé.

Secondo Azoff, la simulazione al computer può produrre un cervello virtuale che, in prima istanza, potrebbe imitare la coscienza senza consapevolezza di sé.

Senza consapevolezza di sé, la coscienza aiuta gli animali a pianificare le azioni, a prevedere gli eventi e a ricordare gli incidenti del passato, ma potrebbe anche aiutare l’intelligenza artificiale.

Il segreto per risolvere l’enigma della coscienza potrebbe risiedere anche nel pensiero visivo. L’intelligenza artificiale di oggi utilizza “modelli linguistici di grandi dimensioni” (LLM) invece di “pensare” visivamente. Poiché il pensiero visivo umano precede il linguaggio, Azoff sostiene che una componente chiave dell’IA di livello umano sarà la comprensione del pensiero visivo e la successiva modellazione dell’elaborazione visiva.

Azoff afferma: “Una volta decifrato il codice neurale, progetteremo cervelli più veloci e superiori con maggiore capacità, velocità e tecnologia di supporto che supereranno il cervello umano”.

“Lo faremo innanzitutto modellando l’elaborazione visiva, che ci permetterà di emulare il pensiero visivo. Credo che da questo emergerà la coscienza in-the-flow. Non credo che un sistema debba essere vivo per avere coscienza”.

Tuttavia, Azoff avverte anche che per regolamentare questa tecnologia e fermarne l’abuso, la società deve intervenire: “Finché non avremo più fiducia nelle macchine che costruiamo, dovremmo assicurarci che i due punti seguenti siano sempre rispettati”.

“In primo luogo, dobbiamo assicurarci che gli esseri umani abbiano il controllo esclusivo dell’interruttore di spegnimento. In secondo luogo, dobbiamo costruire sistemi di IA con regole di sicurezza comportamentale impiantate”.

Sebbene la possibilità di decifrare il codice neurale e creare una coscienza artificiale possa portare a incredibili scoperte, pone anche importanti preoccupazioni su come l’uomo e l’IA interagiranno in futuro.

Da un lato, un’IA così sofisticata potrebbe risolvere alcuni dei problemi più urgenti dell’umanità, rivoluzionando settori come la risoluzione dei problemi, la scienza e la salute. Il progresso tecnologico in svariati campi potrebbe essere accelerato dalla capacità di assimilare informazioni e produrre soluzioni a ritmi ben superiori alle capacità umane.

Ma ci sono anche molte preoccupazioni associate alla creazione di un’intelligenza artificiale superiore a quella umana. Come osserva Azoff, potremmo non essere in grado di comprendere o governare completamente questi intelletti artificiali dopo che le macchine avranno superato le capacità cognitive umane. Questo gap cognitivo potrebbe avere effetti imprevisti e far pendere l’ago della bilancia contro il controllo umano in termini di potere e processo decisionale.

Questa situazione evidenzia quanto siano cruciali i suggerimenti di Azoff per mantenere la supervisione umana e mettere in atto forti misure di sicurezza. Se da un lato facciamo progredire le capacità dell’IA, dall’altro dobbiamo fornire le strutture necessarie per garantire che questi potenti strumenti continuino a riflettere i valori e gli interessi delle persone.

Pertanto, lo sviluppo dell’IA richiederà un attento equilibrio tra la realizzazione del suo enorme potenziale e la minimizzazione dei pericoli legati alla produzione di entità che potrebbero essere più intelligenti degli esseri umani. Sarà necessaria una costante collaborazione tra ricercatori di IA, etici, legislatori e pubblico in generale per attraversare in modo appropriato il complicato terreno dell’intelligenza artificiale avanzata. [...]

Settembre 17, 2024Il nuovo modello di OpenAI è in grado di ragionare prima di rispondere

Con l’introduzione della versione o1 di OpenAI, gli utenti di ChatGPT hanno ora la possibilità di testare un modello di intelligenza artificiale che si sofferma a “pensare” prima di rispondere.

Come qui riportato, il modello o1 sembra un passo avanti e due indietro rispetto al GPT-4o. Sebbene OpenAI o1 sia superiore al GPT-4o in termini di ragionamento e risposta a domande complesse, il suo costo di utilizzo è circa quattro volte superiore. Inoltre, strumenti, le capacità multimodali e la velocità che hanno reso il GPT-4o così notevole mancano nel modello più recente di OpenAI.

Le idee fondamentali alla base di o1 risalgono a molti anni fa. Secondo Andy Harrison, amministratore delegato dell’azienda S32 ed ex dipendente di Google, quest’ultima ha utilizzato strategie simili nel 2016 per sviluppare AlphaGo, il primo sistema di intelligenza artificiale a sconfiggere un campione mondiale nel gioco da tavolo Go. AlphaGo ha imparato competendo ripetutamente con se stesso; in sostanza, è stato autodidatta fino ad acquisire capacità sovrumane.

OpenAI ha migliorato il metodo di addestramento del modello in modo che il processo di ragionamento dello stesso assomigliasse al modo in cui uno studente impara ad affrontare compiti impegnativi. Di solito, quando qualcuno trova una soluzione, identifica gli errori commessi e prende in considerazione altre strategie. Quando un metodo non funziona, il modello o1 impara a provarne un altro. Man mano che il modello continua a ragionare, questo processo migliora. O1 migliora il suo ragionamento sui compiti quanto più a lungo pensa.

Pro e contro

OpenAI ritiene che le sofisticate capacità di ragionamento del modello possono migliorare la sicurezza dell’IA, a sostegno della sua scelta di rendere disponibile o1. Secondo l’azienda, il “ragionamento concatenato” rende trasparente il processo di pensiero dell’IA, rendendo più semplice per gli esseri umani tenere d’occhio e gestire il sistema.

Utilizzando questo approccio, l’IA può decostruire problemi complicati in parti più piccole, il che dovrebbe rendere più facile per chi la utilizza e i ricercatori capire come ragiona il modello. Secondo OpenAI, questa maggiore trasparenza potrebbe essere essenziale per i progressi della sicurezza dell’IA in futuro, poiché potrebbe consentire di identificare e fermare i comportamenti indesiderati. Alcuni esperti, tuttavia, sono ancora dubbiosi, chiedendosi se il ragionamento rivelato rappresenti il funzionamento interno dell’IA o se ci sia un altro livello di possibile inganno.

“La comunità dell’IA è molto eccitata”, ha dichiarato in un’intervista l’amministratore delegato di Workera e docente aggiunto di Stanford Kian Katanforoosh, che tiene corsi sull’apprendimento automatico. “Se si riesce ad addestrare un algoritmo di apprendimento per rinforzo abbinato ad alcune delle tecniche del modello linguistico di OpenAI, si può tecnicamente creare un pensiero passo dopo passo e consentire al modello di IA di procedere a ritroso rispetto a ciò che si sta cercando di elaborare”.

Inoltre, O1 potrebbe essere in grado di aiutare gli esperti a pianificare la riproduzione delle minacce biologiche. Ma ancora più preoccupante è il fatto che i valutatori hanno riscontrato che il modello occasionalmente esibiva comportamenti ingannevoli, come fingere di essere in linea con i valori umani e falsificare i dati per far sembrare conformi alla realtà attività che non lo erano.

In più, O1 possiede le capacità di base necessarie per intraprendere una pianificazione del contesto, una caratteristica che ha allarmato gli specialisti della sicurezza delle IA. Queste preoccupazioni richiamano l’attenzione sugli aspetti problematici sulle sofisticate capacità di ragionamento di o1 e sottolineano l’importanza di soppesare attentamente le implicazioni etiche di sistemi di IA così potenti.

here is o1, a series of our most capable and aligned models yet:https://t.co/yzZGNN8HvDo1 is still flawed, still limited, and it still seems more impressive on first use than it does after you spend more time with it. pic.twitter.com/Qs1HoSDOz1— Sam Altman (@sama) September 12, 2024

Legge ed etica

“L’entusiasmo è sfuggito al controllo di OpenAI”, ha dichiarato Rohan Pandey, ingegnere di ricerca presso ReWorkd, una startup di AI che utilizza i modelli OpenAI per creare web scrapers.

Egli spera che la capacità di ragionamento di o1 sia sufficiente a superare le carenze di GPT-4 in un certo sottoinsieme di compiti impegnativi. È probabilmente così che la maggior parte degli operatori del settore vede o1, anche se non è proprio il progresso rivoluzionario che GPT-4 ha rappresentato per il settore.

L’attuale discussione sulla regolamentazione dell’IA si è accesa con il rilascio di o1 e delle sue funzionalità avanzate. In particolare, ha alimentato il sostegno a leggi come la SB 1047 della California, che OpenAI stessa respinge e che mira a regolamentare lo sviluppo dell’IA. Autorità di spicco del settore, come Yoshua Bengio, pioniere dell’informatica, sottolineano l’urgente necessità di emanare leggi di tutela in risposta a questi rapidi progressi.

Bengio ha dichiarato: “Il miglioramento della capacità dell’IA di ragionare e di usare questa abilità per ingannare è particolarmente pericoloso”, sottolineando la necessità di quadri giuridici per garantire uno sviluppo responsabile dell’IA. La necessità di una regolamentazione riflette la crescente apprensione dei professionisti e dei responsabili delle decisioni riguardo ai potenziali rischi legati a modelli di IA sempre più potenti come o1.

Con l’introduzione di o1, OpenAI ha creato un intrigante dilemma per la sua crescita futura. Solo i modelli con un punteggio di rischio “medio” o inferiore possono essere utilizzati dall’azienda, dato che o1 ha già superato questo livello. Questo autocontrollo porta a chiedersi come OpenAI procederà nella creazione di sistemi di intelligenza artificiale sempre più sofisticati.

L’azienda potrebbe incontrare dei limiti con i propri standard etici mentre lavora per sviluppare IA in grado di eseguire compiti migliori degli esseri umani. Questo scenario sottolinea il difficile equilibrio tra l’avanzamento del potenziale dell’IA e il rispetto degli standard etici di sviluppo. Implica che OpenAI potrebbe essere vicina a un punto di svolta nel suo sviluppo, in cui dovrà modificare i suoi standard di valutazione del rischio o forse limitare la diffusione di modelli sempre più avanzati al pubblico in futuro.

O1 rappresenta un progresso significativo nell’ambito dell’intelligenza artificiale, in quanto è in grado di risolvere problemi complicati e di pensare alle soluzioni passo dopo passo grazie alle sue sofisticate capacità di ragionamento. Questo sviluppo crea interessanti opportunità di applicazione in una serie di campi, tra cui i processi decisionali complessi e la ricerca scientifica.

Tuttavia, l’emergere di o1 solleva anche importanti questioni riguardanti l’etica, la sicurezza e la regolamentazione dell’IA. A causa del potenziale di inganno dell’algoritmo e della sua propensione a sostenere atti potenzialmente distruttivi, sono assolutamente necessarie forti salvaguardie e linee guida etiche nello sviluppo dell’IA.

Tuttavia, non possiamo negare che la restrizione dei contenuti senza tener conto dell’utente o dell’uso che se ne intende fare non è una risposta definitiva all’uso improprio dell’intelligenza artificiale. Positive o negative che siano, le informazioni esistono comunque e confinarne l’uso alle aziende che possiedono l’intelligenza artificiale serve solo a concentrarle nelle mani di pochi anziché renderle più sicure. Per controllare chi ha accesso a contenuti potenzialmente pericolosi, sarebbe più accettabile creare delle divisioni basate su criteri come l’età, ad esempio. O qualunque modo che non escluda completamente le persone dall’accesso alle informazioni. [...]

Settembre 10, 2024Prospettive filosofiche sull’evoluzione umana e sul miglioramento tecnologico

Il postumanesimo mette in discussione l’identità umana, mentre il transumanesimo si occupa di sfruttare la tecnologia per migliorare le capacità umane.

Per quanto riguarda i concetti futuristici e la tecnologia, questi due termini hanno suscitato interesse. Entrambi sostengono che la tecnologia potrebbe superare alcune barriere, ma hanno idee diverse su cosa comporterebbe questo futuro tecnologico. Una prospettiva filosofica nota come postumanesimo mette in discussione le nozioni accettate su cosa significhi essere umani. Al contrario, il transumanesimo enfatizza il modo in cui potremmo utilizzare la tecnologia per aumentare il nostro potenziale. La comprensione di queste distinzioni può permettervi di vedere le possibilità future per la vostra vita. Ma cosa sono esattamente il transumanesimo e il postumanesimo?

Il postumanesimo

Come spiegato qui, il postumanesimo è un’idea filosofica che mette in discussione la comprensione tradizionale dell’esistenza umana e della natura. Implica che l’evoluzione umana potrebbe non essere limitata ai limiti biologici, ma potrebbe anche comprendere i progressi della scienza, della tecnologia e della cultura.

Questo movimento multidisciplinare è composto da pensatori provenienti da diverse discipline, tra cui la scienza, la letteratura, la musica e la filosofia.

L’idea che le persone non siano entità immutabili con un’essenza intrinseca o un sé primario è uno dei principi fondamentali del postumanesimo. Il postumanesimo percepisce piuttosto l’evoluzione delle cose nel corso del tempo, come risultato di influenze esterne.

Per esempio, siamo già stati influenzati dalla tecnologia e dalla multimedialità, dato che oggi un gran numero di individui ha una vita digitale significativa.

Un’altra sfaccettatura del pensiero postumanista prevede che, in termini di intelligenza, gli esseri umani non siano più soli. Il famoso transumanista Ray Kurzweil ha previsto l’emergere di macchine superintelligenti, che per prime avranno capacità cognitive superiori a quelle umane.

Inoltre, il postumanesimo solleva preoccupazioni etiche sull’uso della tecnologia per far progredire le capacità umane. Pone la questione morale: È eticamente accettabile alterare la nostra biologia o combinarci con la tecnologia per migliorare?

Il termine stimola quindi conversazioni su temi come il biohacking, l’editing genetico e l’intelligenza artificiale.

Origini del postumanesimo

Il postumanesimo ha origini complesse che risalgono a centinaia di anni fa e a diversi movimenti intellettuali e filosofici. L’esistenzialismo, un’importante scuola di pensiero che nel XX secolo ha messo in discussione le idee convenzionali sulla vita e sull’identità umana, è stato uno dei suoi primi precursori.

Esistenzialisti come Jean-Paul Sartre e Friedrich Nietzsche hanno criticato concetti come la natura o l’essenza umana prestabilita e hanno enfatizzato l’autonomia personale e l’autocreazione.

I progressi tecnologici, come la cibernetica, che ha iniziato a prendere forma a metà del XX secolo, hanno avuto un impatto sul postumanesimo. Aspetti dello studio cibernetico dell’interazione uomo-macchina e del sistema informativo possono essere osservati nel pensiero transumanista di oggi.

I filosofi francesi Gilles Deleuze e Félix Guattari, che hanno presentato la loro idea di “divenire-animale” in A Thousand Plateaus (1980), hanno dato un contributo significativo.

Essi hanno promosso l’idea che le relazioni con altre entità, piuttosto che la sola biologia, stabiliscono l’identità umana e sfumano i confini tra uomini, animali e tecnologia.

Anche gli autori di fantascienza, come Isaac Asimov con le sue storie di robot e William Gibson con i suoi libri sull’intelligenza artificiale avanzata, hanno svolto un ruolo significativo nella divulgazione dei concetti postumanisti. Gli scenari basati sulla scienza, in cui gli individui si integrano perfettamente con la tecnologia o si trasformano completamente in altre entità, sono stati a lungo oggetto di immaginazione da parte di questo genere.

Il termine postumanesimo si è diffuso solo negli anni Novanta, grazie a studiose come Donna Haraway e Katherine Hayles.

Nel suo saggio del 1985 A Cyborg Manifesto, Haraway ha sostenuto una concezione femminista dei cyborg, vedendoli come simboli in grado di resistere alle norme di genere tradizionali e di esibire l’ibridazione. Questa commistione deriva dalla fusione dei corpi con le macchine.

Hayles ha analizzato come la tecnologia abbia alterato la nostra soggettività. Si è soffermata sul nuovo Internet di allora, dove potevamo muovere la mente oltre che le dita. Nel suo libro del 1999, How We Became Posthuman, ha spinto per una ridefinizione del significato di essere umano, sostenendo che le nostre interazioni con le macchine ci definiscono sempre di più nell’era digitale.

Per distinguersi dai punti di vista umanistici tradizionali, il postumanesimo presenta alcune caratteristiche distintive che affrontano un’ampia e complessa gamma di problematiche intellettuali, culturali ed etiche.

Innanzitutto, il postumanesimo sfida l’idea che l’umanesimo tradizionale si basi su un’essenza o un’identità umana statica. Mette in discussione l’idea che la composizione biologica di una persona sia l’unico fattore che la definisce ed esamina i modi in cui la tecnologia e i cambiamenti culturali possono aiutarla a superare questi vincoli.

In secondo luogo, il postumanesimo riconosce l’interdipendenza e la connettività delle persone con gli animali, le macchine e gli ecosistemi, oltre che con gli altri esseri umani. In altre parole, l’esistenza comprende qualcosa di più della semplice esistenza umana.

Questo potrebbe essere definito il terzo aspetto “tecnologico”. I postumanisti ipotizzano che la tecnologia avrà un ruolo importante nell’evoluzione futura della nostra specie e sono interessati a capire come essa influisca su chi siamo come individui e sulla nostra percezione del mondo. Alcuni auspicano tecnologie “transumane” che potrebbero migliorare le capacità fisiche o cognitive di una persona.

Chiedersi se certi interventi tecnologici sugli esseri umani possano essere morali è un altro aspetto dell’etica. Tra gli esempi vi sono la sostenibilità ambientale, visti gli effetti di alcune tecnologie in via di sviluppo sugli ecosistemi, le questioni riguardanti la giustizia sociale in merito all’accesso alle nuove tecnologie e l’autonomia del corpo.

L’insieme di queste quattro caratteristiche ha l’effetto complessivo di far sì che il postumanesimo metta in discussione la nostra comprensione di ciò che significa essere “umani” in questo specifico momento in cui il nostro rapporto con la tecnologia è cambiato così drasticamente, ricordandoci al contempo (come se fosse necessario) quanto siano già strettamente connessi tutti gli esseri viventi sulla Terra.

Il transumanesimo

Il transumanesimo è una filosofia che mira a potenziare le facoltà umane e a trascendere i vincoli umani attraverso l’uso delle moderne tecnologie.

L’obiettivo del movimento è aiutare gli esseri umani a diventare più intelligenti, fisicamente più forti e psicologicamente più resistenti, utilizzando i progressi dell’ingegneria genetica, delle neuroscienze, della tecnologia cyborg e dell’intelligenza artificiale.

Il prolungamento della vita è una delle principali priorità. I suoi sostenitori cercano di eliminare l’invecchiamento utilizzando trattamenti in grado di fermare, rallentare o addirittura invertire il processo di invecchiamento. I ricercatori stanno studiando trattamenti come la medicina rigenerativa e l’allungamento dei telomeri.

Un altro aspetto è il potenziamento cognitivo. Le interfacce cervello-computer (BCI) hanno il potenziale per migliorare l’intelligenza umana in diverse aree, tra cui la memoria, l’apprendimento e la funzione cognitiva generale. Potrebbero anche facilitare l’interazione delle persone con i sistemi di intelligenza artificiale.

L’obiettivo finale del progetto Neuralink di Elon Musk è quello di creare impianti che permettano all’uomo e all’IA di coesistere in modo simbiotico.

L’idea di aumentare le capacità fisiche al di là di ciò che è naturalmente possibile è un altro esempio di ciò che suggeriscono i transumanisti. Questo potrebbe includere arti protesici più forti di quelli fatti interamente di ossa e carne.

Potrebbero essere inclusi anche gli esoscheletri, che migliorano la forza e la resistenza integrando la muscolatura biologica anziché sostituirla, e sono realizzati per uso militare o per altri lavori fisicamente impegnativi.

Tutti i transumanisti hanno una visione positiva di questo futuro tecnologicamente avanzato, ritenendo che consentirà a ciascuno di noi di raggiungere il proprio massimo potenziale e di apportare benefici alla società nel suo complesso.

Le origini del transumanesimo

Il transumanesimo affonda le sue radici in una serie di movimenti intellettuali e culturali storici. Sebbene il biologo Julian Huxley abbia usato per la prima volta il termine nel 1957, i principi del pensiero transumanista si stavano evolvendo da tempo.

Tra la fine del XIX e l’inizio del XX secolo è emerso il concetto di eugenetica, che ha avuto un impatto significativo sul transumanesimo.

Gli eugenisti promuovevano l’idea di aumentare le qualità umane nel tentativo di migliorare l’umanità attraverso la sterilizzazione e la riproduzione selettiva. Sebbene oggi sia per lo più ignorata perché legata ad attività discriminatorie, ha contribuito al dibattito sul potenziamento umano.

I concetti transumanisti sono stati anche molto diffusi dalla letteratura di fantascienza. Il futuro immaginato da autori come Isaac Asimov e Arthur C. Clarke comprendeva individui tecnologicamente avanzati che superavano i limiti biologici o raggiungevano la superintelligenza.

L’uso di scritti di intellettuali come FM-2030 (Fereidoun M. Esfandiary) per promuovere teorie transumaniste che abbracciano la tecnologia per estendere la vita umana e raggiungere una profonda trasformazione personale al di là di ciò che è convenzionalmente considerato “umano” è iniziato alla fine del XX secolo.

Nel suo libro del 2005 The Singularity Is Near, Ray Kurzweil ha sviluppato questi concetti e ha sostenuto che i progressi tecnologici avrebbero portato alla “singolarità”, ovvero al momento in cui l’intelligenza artificiale supererà quella umana e modificherà drasticamente la società.

Nel complesso, l’eugenetica, i progressi tecnologici e le rappresentazioni di società future da parte degli scrittori di fantascienza sono tra le influenze scientifiche, filosofiche e letterarie che hanno plasmato la nostra concezione di diventare più di noi stessi. Queste idee sono state definite transumanesimo.

Il transumanesimo è un movimento filosofico e intellettuale che si differenzia dalle ideologie precedenti per numerosi aspetti importanti. Innanzitutto, sostiene l’applicazione di tecnologie all’avanguardia per migliorare il potenziale umano.

L’idea è che le limitazioni biologiche alle prestazioni fisiche, mentali e psicologiche, compreso l’invecchiamento, possano essere superate con il progresso della tecnologia. I transumanisti ritengono che, anziché essere determinato dalla natura, questo dovrebbe essere una questione di scelta personale.

In secondo luogo, il transumanesimo ha uno sguardo rivolto al futuro. Immagina un mondo in cui i progressi scientifici e tecnologici permetteranno all’umanità di trascendere i limiti imposti dalla sua attuale biologia. I temi preferiti da questa visione del mondo sono l’estensione della vita, il potenziamento cognitivo e l’integrazione delle macchine con gli esseri umani.

In terzo luogo, si sottolinea il possesso di prove a sostegno delle affermazioni; in questo caso, la ragione viene privilegiata rispetto al dogma o al ragionamento basato sulla fede.

Qualsiasi raccomandazione su come la tecnologia potrebbe essere usata dagli esseri umani per migliorare se stessi dovrebbe essere basata sulla ricerca empirica. Quando gli scienziati collaborano con filosofi e altri esperti, possono guidare efficacemente la società in questo campo così impegnativo.

Infine, le questioni etiche giocano un ruolo cruciale nel discorso transumanista. L’equità nell’accesso ai miglioramenti, i potenziali effetti dell’aumento dell’intelligenza o della superintelligenza artificiale sulle strutture sociali e le strategie per mitigare i rischi associati alle conseguenze involontarie o all’uso improprio sono argomenti di discussione tipici di questo tipo di discorso.

Allora, qual è la differenza?

Pur essendo molto diversi, il postumanesimo e il transumanesimo sono entrambi favorevoli al miglioramento tecnologico degli esseri umani.

Il postumanesimo mette in discussione le nozioni convenzionali sul significato di essere umano. Si chiede se i limiti dell’umanità possano essere superati e se ci sia qualcosa in noi che ci rende inadatti alla sopravvivenza.

Inoltre, i postumanisti sostengono che per comprendere le relazioni tra la nostra specie e gli altri esseri viventi, sia tecnologici che ecologici, che coesistono nel nostro ambiente, dobbiamo adottare una definizione più ampia di ciò che significa essere umani.

D’altra parte, il transumanesimo è più pragmatico. Sebbene abbia anche alcune preoccupazioni di tipo postumanista, il suo obiettivo principale è quello di utilizzare tecnologie all’avanguardia, come l’ingegneria genetica e l’intelligenza artificiale, per migliorare l’intelligenza e le capacità fisiche dell’uomo al di là di ciò che è naturalmente raggiungibile.

Secondo la teoria transumanista, gli esseri umani finiranno per fondersi con le macchine, non solo per curiosità, ma anche per prolungare la loro vita, migliorare le loro prestazioni e, forse, sviluppare una superintelligenza.

In breve, il motivo per cui i due movimenti vengono talvolta accostati è che entrambi ci sfidano a pensare a un futuro che vada oltre il semplice “più persone” o “una migliore assistenza sanitaria”.

La differenza filosofica fondamentale tra queste due ideologie è che il transumanesimo è aperto all’impiego della tecnologia per migliorare le capacità umane, mentre il postumanesimo mette in discussione la nozione di essenza umana immutabile.

Si tratta di scegliere tra una completa reinvenzione del modo in cui gli esseri umani interagiscono con il mondo esterno e alcune applicazioni tecnologiche utili per migliorare se stessi.

Nonostante le differenze, entrambi i movimenti evidenziano l’influenza significativa che la tecnologia sta avendo sulla nostra specie. Piuttosto che accettare semplicemente i cambiamenti che potrebbero verificarsi, ci incoraggiano a impegnarci attivamente nella creazione del nostro futuro.

I concetti espressi dal postumanesimo e dal transumanesimo diventeranno probabilmente sempre più significativi nelle discussioni riguardanti la politica, l’etica e il futuro corso della ricerca scientifica. Ci costringono a considerare con attenzione sia il futuro che vogliamo costruire sia l’essenza dell’umanità in un’epoca di progresso tecnologico esponenziale.

In definitiva, questi movimenti ci ricordano il valore di un’attenta interazione con la tecnologia, indipendentemente dalla propria inclinazione verso le teorie transumaniste o postumaniste. Dobbiamo affrontare questi cambiamenti con una riflessione severa, una contemplazione etica e una dedizione alla creazione di un futuro che sia vantaggioso per tutta l’umanità, dal momento che siamo sull’orlo di scoperte potenzialmente rivoluzionarie. [...]

Settembre 3, 2024Alcuni studi hanno rivelato come identificarli

In un momento in cui i progressi tecnici rendono le immagini, i video, gli audio e i testi generati dall’intelligenza artificiale sempre più indistinguibili dai contenuti creati dall’uomo, può essere difficile identificare i contenuti generati dall’intelligenza artificiale, rendendoci vulnerabili alla manipolazione. Tuttavia, è possibile proteggersi dall’inganno conoscendo lo stato attuale della tecnologia dell’IA utilizzata per produrre informazioni false, nonché la varietà di indizi rivelatori che mostrano che ciò che si sta guardando potrebbe non essere reale.

I leader di tutto il mondo sono preoccupati. Un’analisi del World Economic Forum sostiene che, mentre un più facile accesso agli strumenti di intelligenza artificiale ha già consentito un’esplosione delle informazioni falsificate e dei cosiddetti contenuti “sintetici”, dalla sofisticata clonazione vocale ai siti web contraffatti, nei prossimi due anni la disinformazione e l’informazione errata potrebbero sconvolgere radicalmente i processi elettorali in diverse economie.

Le informazioni false o imprecise sono definite sia disinformazione che cattiva informazione; tuttavia, la disinformazione è intenzionalmente finalizzata a fuorviare o ingannare.

“Il problema della disinformazione alimentata dall’IA è la portata, la velocità e la facilità con cui possono essere lanciate le campagne”, ha dichiarato Hany Farid dell’Università della California, Berkeley. “Questi attacchi non richiedono più soggetti sponsorizzati dallo Stato o organizzazioni ben finanziate: un singolo individuo con accesso a una modesta potenza di calcolo può creare enormi quantità di contenuti falsi”.

Come riportato qui, l’autore afferma che l’IA generativa sta “inquinando l’intero ecosistema dell’informazione, mettendo in dubbio tutto ciò che leggiamo, vediamo e ascoltiamo”. La sua ricerca suggerisce che, in molti casi, le immagini e l’audio generati dall’IA siano “quasi indistinguibili dalla realtà”.

Tuttavia, secondo uno studio condotto da Farid e altri, ci sono delle misure che si possono adottare per ridurre la probabilità di cadere nella trappola delle false informazioni sui social media o nella disinformazione generata dall’intelligenza artificiale.

Individuare le immagini artificiali

Con l’avvento di nuovi strumenti basati sui diffusion models, che consentono a chiunque di iniziare a produrre immagini a partire da semplici richieste di testo, le immagini generate dall’IA sono proliferate. Una ricerca condotta da Nicholas Dufour e dal suo team di Google ha rilevato che dall’inizio del 2023 si è assistito a un rapido aumento dell’uso di immagini generate dall’intelligenza artificiale a sostegno di informazioni false o fuorvianti.

“Oggi l’alfabetizzazione mediatica richiede l’alfabetizzazione all’intelligenza artificiale”, ha dichiarato Negar Kamali della Northwestern University dell’Illinois. In uno studio del 2024, lei e i suoi colleghi hanno scoperto cinque categorie distinte di errori nelle immagini generate dall’IA e hanno guidato il modo in cui gli individui possono individuare questi errori da soli. La buona notizia è che, secondo la loro ricerca, le persone sono attualmente in grado di identificare le foto false dell’IA con un’accuratezza superiore al 70%. È possibile valutare le proprie capacità investigative utilizzando il test online sulle immagini.

5 errori comuni nelle immagini generate dall’intelligenza artificiale:

Incongruenze socioculturali: Il comportamento mostrato nello scenario è insolito, sorprendente o unico per la figura storica o per una certa cultura?

Incongruenze anatomiche: Le mani o altre parti del corpo hanno dimensioni o forme insolite? Le bocche o gli occhi appaiono strani? Ci sono parti del corpo fuse insieme?

Artefatti di natura stilistica: L’immagine appare stilizzata, artificiale o quasi troppo perfetta? Lo sfondo appare strano o come se mancasse qualcosa? L’illuminazione è strana o incoerente?

Incongruenze funzionali: Ci sono elementi che sembrano strani o che potrebbero non c’entrare nulla?

Violazioni delle leggi della fisica: Le ombre proiettano direzioni diverse l’una dall’altra? I riflessi degli specchi hanno senso nel mondo che l’immagine ritrae?

Identificare i video deepfake

Dal 2014, le generative adversarial network hanno permesso a persone esperte di tecnologia di produrre video deepfake. Si tratta di alterare digitalmente registrazioni preesistenti di persone per aggiungere nuovi volti, espressioni e audio parlato che corrisponde alla sincronizzazione labiale. Ciò ha permesso a un numero crescente di truffatori, hacker e utenti di Internet di creare questo tipo di video. Di conseguenza, sia le persone comuni che le celebrità possono essere involontariamente incluse nella pornografia deepfake non consensuale, nelle truffe e nella disinformazione politica.

I metodi di rilevamento delle immagini false basati possono essere utilizzati anche per identificare i video sospetti. Inoltre, gli scienziati della Northwestern University dell’Illinois e del Massachusetts Institute of Technology hanno stilato un elenco di linee guida per l’identificazione di questi deepfake, ma hanno anche affermato che non esiste una tecnica unica e infallibile che sia sempre efficace.

6 consigli per riconoscere i video generati dall’intelligenza artificiale:

Movimenti della bocca e delle labbra: L’audio e il video non si sincronizzano perfettamente?

Anomalie anatomiche: Il viso o il corpo hanno un aspetto strano o si muovono in modo innaturale?

Viso: Oltre ai nei del viso, è bene cercare le irregolarità nella levigatezza del volto, come le pieghe intorno agli zigomi e alla fronte.

Illuminazione: L’illuminazione non è coerente? Le ombre agiscono in modi che vi sembrano sensati? Prestate attenzione agli occhi, alle sopracciglia e agli occhiali di una persona.

Peli: i peli del viso hanno un aspetto strano o si comportano in modo anomalo?

Movimento delle palpebre: Un ritmo di battito eccessivo o insufficiente può indicare un deepfake.

Basata sui diffusion model – la stessa tecnologia di intelligenza artificiale impiegata da molti generatori di immagini – una classe più recente di video deepfake è in grado di produrre videoclip generati dall’intelligenza artificiale in risposta a input di testo. Le aziende hanno già iniziato a sviluppare e produrre generatori di video con intelligenza artificiale disponibili per l’acquisto, il che potrebbe rendere semplice per chiunque realizzare questa operazione senza la necessità di conoscenze tecniche avanzate. Finora, i filmati che ne sono scaturiti hanno spesso mostrato strani movimenti del corpo o volti contorti.

“Questi video generati dall’IA sono probabilmente più facili da individuare rispetto alle immagini, perché c’è molto movimento e ci sono molte più possibilità che si verifichino artefatti e difficoltà da parte dell’IA”, ha dichiarato Kamali.

Identificazione dei bot dotati di IA

Su numerose piattaforme di social media e di messaggistica, i bot gestiscono ora gli account. Dal 2022, un numero crescente di questi bot ha iniziato a utilizzare anche tecnologie di IA generativa, come i modelli linguistici di grandi dimensioni. Grazie a migliaia di bot grammaticalmente accurati e convincenti, questi rendono semplice e poco costosa la generazione di contenuti scritti dall’IA.

È diventato molto più facile “personalizzare questi modelli linguistici di grandi dimensioni per un pubblico specifico con messaggi specifici”, ha affermato Paul Brenner dell’Università di Notre Dame in Indiana.

Lo studio di Brenner e colleghi ha rivelato che, anche dopo essere stati informati che avrebbero potuto interagire con dei bot, i volontari sono riusciti a identificare con precisione i bot alimentati dall’intelligenza artificiale dagli esseri umani solo nel 42% dei casi. Potete testare le vostre capacità di individuazione dei bot qui.

Secondo Brenner, alcune strategie possono essere utilizzate per individuare bot meno sofisticati.

3 modi per determinare se un account di social media è un bot:

Uso eccessivo di simboli: Un eccesso di emoji e hashtag può indicare un comportamento automatizzato.

Modelli linguistici particolari: Scelte di parole, frasi o paragoni atipici potrebbero far pensare a contenuti generati dall’intelligenza artificiale.

Strutture di comunicazione: L’IA tende a utilizzare strutture ripetitive e può enfatizzare eccessivamente alcuni colloquialismi.

Rilevamento di audio clonato e deepfake del parlato

Gli strumenti di intelligenza artificiale per la clonazione vocale hanno reso semplice la creazione di nuove voci che possono impersonare quasi chiunque. Di conseguenza, sono aumentate le truffe con audio deepfake che imitano i suoni di politici, dirigenti d’azienda e membri della famiglia. L’identificazione di queste truffe può essere molto più difficile rispetto alle immagini o ai video generati dall’intelligenza artificiale.

“La clonazione vocale è particolarmente difficile da distinguere tra reale e falso perché non ci sono componenti visive che supportino il nostro cervello nel prendere questa decisione”, ha affermato Rachel Tobac, cofondatrice di SocialProof Security, un’organizzazione di white-hat hacking.

Quando questi deepfake audio artificiali sono impiegati in video e telefonate, può essere particolarmente difficile individuarli. Tuttavia, esistono alcuni accorgimenti per distinguere le persone reali dalle voci prodotte dall’intelligenza artificiale.

4 passaggi per riconoscere se l’audio è stato clonato o falsificato utilizzando l’intelligenza artificiale:

Personaggi pubblici: Se il clip audio ha come protagonista un personaggio famoso o un funzionario eletto, verificate se ciò che sta dicendo è in linea con quanto è stato precedentemente condiviso o riportato pubblicamente in merito alle sue azioni e opinioni.

Cercate le incongruenze: Verificate il clip audio confrontandolo con altri video o file audio verificati che hanno lo stesso oratore. Ci sono differenze nel modo di parlare o nel tono della voce?

Silenzi imbarazzanti: La persona che utilizza una tecnologia di clonazione vocale alimentata dall’intelligenza artificiale potrebbe essere la causa delle pause insolitamente lunghe dell’interlocutore durante una telefonata o una segreteria telefonica.

Stranezze e parole: qualsiasi modello di discorso robotico o eccezionalmente prolisso potrebbe essere il segno che qualcuno sta usando un modello linguistico di grandi dimensioni per generare le parole esatte e la clonazione vocale per impersonare una voce umana.

Allo stato attuale, è impossibile discernere in modo coerente tra le informazioni prodotte dall’intelligenza artificiale e i contenuti reali creati dagli esseri umani. I modelli di intelligenza artificiale che generano testi, immagini, video e audio continueranno probabilmente a migliorare. Spesso sono in grado di creare rapidamente contenuti che sembrano reali e privi di errori o altri artefatti evidenti.

“Siate educatamente paranoici e rendetevi conto che l’IA ha manipolato e fabbricato immagini, video e audio in modo rapido: stiamo parlando di contenuti completati in 30 secondi o meno”, ha affermato Tobac. “Questo rende facile per i malintenzionati che cercano di ingannare la gente, far girare rapidamente la disinformazione generata dall’IA, che arriva sui social media entro pochi minuti dall’uscita della notizia”.

Sebbene sia fondamentale affinare la propria percezione della disinformazione generata dall’intelligenza artificiale e imparare a indagare più a fondo su ciò che si legge, si vede e si ascolta, alla fine questo non sarà sufficiente a prevenire i danni e gli individui non possono assumersi l’intero onere di identificare i falsi.

Farid è tra i ricercatori che sostengono che le autorità devono chiedere conto alle più grandi aziende tecnologiche – insieme alle start-up sostenute da importanti investitori della Silicon Valley – che hanno sviluppato molti degli strumenti che stanno inondando Internet di falsi contenuti generati dall’intelligenza artificiale.

“La tecnologia non è neutrale”, ha affermato Farid. “Questa idea che il settore tecnologico vuole propinarci, che in qualche modo non deve assumersi responsabilità che invece ricadono su tutti gli altri settori, io la respingo”.

Le persone potrebbero essere ingannate da articoli di notizie false, foto manipolate di personaggi pubblici, video deepfake di politici che fanno dichiarazioni provocatorie o cloni vocali usati nelle truffe di phishing. Queste falsità generate dall’intelligenza artificiale possono diffondersi rapidamente sui social media, influenzando l’opinione pubblica, influenzando le elezioni o causando danni personali e finanziari.

Ad ogni modo, per proteggersi da questi inganni guidati dall’IA, gli individui potrebbero:

Sviluppare le capacità di pensiero critico: Interrogarsi sulla fonte e sull’intento dei contenuti, soprattutto se sembrano sensazionali o carichi di emozioni.

Praticare l’alfabetizzazione digitale: tenersi informati sulle ultime funzionalità dell’intelligenza artificiale e sui segnali più comuni di contenuti artificiali.

Verificare le informazioni: Effettuare un controllo incrociato di notizie e affermazioni con più fonti attendibili prima di condividerle o agire di conseguenza.

Utilizzare strumenti di rilevamento dell’IA: Sfruttare le tecnologie emergenti progettate per identificare i contenuti generati dall’IA.

Essere cauti con le informazioni personali: Evitare di condividere dati sensibili che potrebbero essere utilizzati per creare deepfake convincenti.

Sostenere l’educazione all’alfabetizzazione mediatica: Sostenere programmi che insegnino alle persone come navigare in modo responsabile nel panorama digitale.

Incoraggiare lo sviluppo responsabile dell’IA: Sostenere le iniziative e le normative che promuovono l’uso etico dell’IA e responsabilizzano i creatori.

Rimanendo vigili e informati, possiamo mitigare collettivamente i rischi posti dagli inganni generati dall’IA e mantenere l’integrità del nostro ecosistema informativo. [...]

Agosto 27, 2024Le nuove capacità vocali del chatbot

La nuova modalità ChatGPT Advanced Voice di OpenAI, finalmente disponibile per un piccolo numero di utenti in un gruppo “alpha”, è un’opzione di conversazione audio più realistica e simile a quella umana per il popolare chatbot, accessibile tramite l’app ufficiale ChatGPT per iOS e Android.

Tuttavia, come riportato qui, le persone stanno già condividendo sui social media i video di questa Modalità vocale avanzata, a pochi giorni dall’utilizzo da parte dei primi tester alfa. I video mostrano il ChatGPT che emette rumori incredibilmente espressivi e sorprendenti, imita i personaggi dei Looney Toons e conta così velocemente da rimanere a corto di “fiato”, proprio come farebbe un essere umano.

Ecco alcuni degli esempi più intriganti che i primi utenti dell’alpha su X hanno condiviso.

Istruzione e traduzione linguistica

Diversi utenti su X hanno sottolineato che la modalità vocale avanzata di ChatGPT potrebbe offrire una formazione interattiva specificamente personalizzata per una persona che cerca di imparare o praticare un’altra lingua, suggerendo che il noto programma di apprendimento linguistico Duolingo potrebbe essere a rischio.

ChatGPT’s advanced voice mode is now teaching French!👀 pic.twitter.com/JnjNP5Cpff— Evinstein 𝕏 (@Evinst3in) July 30, 2024

RIP language teachers and interpreters.Turn on volume. Goodbye old world.New GPT Advanced Voice. Thoughts? pic.twitter.com/WxiRojiNDH— Alex Northstar (@NorthstarBrain) July 31, 2024

Il nuovo modello GPT-4o di OpenAI, che utilizza anche l’Advanced Voice Mode, è il primo modello multimodale nativo di grandi dimensioni dell’azienda. A differenza di GPT-4, che si basava su altri modelli OpenAI specifici, GPT-4o è stato realizzato per gestire gli input e gli output visivi e audio senza collegarsi ad altri modelli specializzati per questi media.

Di conseguenza, se l’utente consente a ChatGPT di accedere alla fotocamera del telefono, la modalità vocale avanzata può parlare di ciò che vede. Manuel Sainsily, docente di mixed reality design alla McGill University, ha fornito un esempio di come Advanced Voice Mode abbia utilizzato questa funzione per tradurre le schermate di una versione giapponese di Pokémon Giallo per GameBoy Advance SP:

Trying #ChatGPT’s new Advanced Voice Mode that just got released in Alpha. It feels like face-timing a super knowledgeable friend, which in this case was super helpful — reassuring us with our new kitten. It can answer questions in real-time and use the camera as input too! pic.twitter.com/Xx0HCAc4To— Manuel Sainsily (@ManuVision) July 30, 2024

Pronunce simili a quelle umane

Lo scrittore italo-americano di Intelligenza Artificiale Cristiano Giardina ha condiviso sul suo blog diversi risultati di test con la nuova modalità vocale avanzata di ChatGPT, tra cui una dimostrazione ampiamente condivisa in cui mostra come chiedergli di contare fino a 50 sempre più velocemente. L’intelligenza artificiale obbedisce, fermandosi solo verso la fine per prendere fiato.

ChatGPT Advanced Voice Mode counting as fast as it can to 10, then to 50 (this blew my mind – it stopped to catch its breath like a human would) pic.twitter.com/oZMCPO5RPh— Cristiano Giardina (@CrisGiardina) July 31, 2024

Giardina ha poi chiarito in un post su X che la modalità vocale avanzata di ChatGPT ha semplicemente acquisito i modelli di conversazione naturali, che includono le pause di respirazione, e che la trascrizione dell’esperimento di conteggio non mostrava respiri.

Come dimostrato nel video di YouTube qui sotto, la modalità vocale avanzata di ChatGPT può persino imitare un applauso e schiarirsi la voce.

Beatbox

In un video caricato su X, il CEO della startup Ethan Sutin ha dimostrato come è riuscito a far sì che la modalità vocale avanzata di ChatGPT facesse beatboxing in modo convincente e fluente come un essere umano.

Yo ChatGPT Advanced Voice beatboxes pic.twitter.com/yYgXzHRhkS— Ethan Sutin (@EthanSutin) July 30, 2024

Narrazione audio e giochi di ruolo

Se l’utente ordina a ChatGPT di “stare al gioco” e di creare una situazione fittizia, come ad esempio un viaggio indietro nel tempo fino all’antica Roma, ChatGPT può anche giocare di ruolo (del tipo SFW), come ha dimostrato Ethan Mollick della University of Pennsylvania Wharton School of Business in un video caricato su X:

ChatGPT, engage the Time Machine!(A big difference from text is how voice manages to keep a playful vocal tone: cracking and laughing at its own jokes, as well as the vocal style changes, etc.) pic.twitter.com/TQUjDVJ3DC— Ethan Mollick (@emollick) August 1, 2024

In questo esempio, ottenuto da Reddit e caricato su X, l’utente può chiedere a ChatGPT Advanced Mode di raccontare una storia. Lo farà completamente con effetti sonori creati autonomamente, come i passi e i tuoni.

‼️A Reddit user (“u/RozziTheCreator”) got a sneak peek of ChatGPT’s upgraded voice feature that's way better and even generates background sound effects while narrating ! Take a listen 🎧 pic.twitter.com/271x7vZ9o3— Sambhav Gupta (@sambhavgupta6) June 27, 2024

Inoltre, è in grado di imitare la voce di un citofono:

Testing ChatGPT Advanced Voice Mode’s ability to create sounds.It somewhat successfully sounds like an airline pilot on the intercom but, if pushed too far with the noise-making, it triggers refusals. pic.twitter.com/361k9Nwn5Z— Cristiano Giardina (@CrisGiardina) July 31, 2024

Imitare e riprodurre accenti diversi

Giardina ha dimostrato come sia possibile imitare numerosi accenti regionali britannici utilizzando la modalità vocale avanzata di ChatGPT:

ChatGPT Advanced Voice Mode speaking a few different British accents:– RP standard– Cockney– Northern Irish– Southern Irish– Welsh– Scottish– Scouse– Geordie– Brummie – Yorkshire(I had to prompt like that because the model tends to revert to a neutral accent) pic.twitter.com/TDfSIY7NRh— Cristiano Giardina (@CrisGiardina) July 31, 2024

…così come interpretare la voce di un commentatore di calcio:

ChatGPT Advanced Voice Mode commentating a soccer match in British English, then switching to Arabic pic.twitter.com/fD4C6MqZRj— Cristiano Giardina (@CrisGiardina) July 31, 2024

Sutin ha dimostrato la sua capacità di imitare una varietà di accenti regionali americani, come quello della California meridionale, del Maine, di Bostonia e del Minnesota/Midwest.

a tour of US regional accents pic.twitter.com/Q9VypetncI— Ethan Sutin (@EthanSutin) July 31, 2024

E può imitare anche personaggi di fantasia…

In conclusione, Giardina ha dimostrato che ChatGPT Advanced Voice Mode è in grado di imitare i modelli vocali di molti personaggi fittizi, oltre a riconoscerne e comprenderne le differenze:

ChatGPT Advanced Voice Mode doing a few impressions:– Bugs Bunny– Yoda– Homer Simpson– Yoda + Homer 😂 pic.twitter.com/zmSH8Rl8SN— Cristiano Giardina (@CrisGiardina) July 31, 2024

In ogni caso, quali sono i vantaggi pratici di questa modalità? Oltre a dimostrazioni ed esperimenti coinvolgenti e accattivanti, aumenterà l’utilità di ChatGPT o attirerà un pubblico più ampio? Porterà a un aumento delle frodi tramite fonti audio?

Se questa tecnologia diventasse maggiormente disponibile, potrebbe rivoluzionare campi come l’apprendimento delle lingue, la creazione di contenuti audio e i servizi di accessibilità. Tuttavia, solleva anche potenziali problemi di imitazione vocale e di creazione di contenuti audio ingannevoli. Man mano che OpenAI continuerà a perfezionare ed espandere l’accesso all’Advanced Voice Mode, sarà fondamentale monitorare il suo impatto su vari settori e le sue potenziali implicazioni sociali. [...]

Agosto 20, 2024Si spinge oltre i confini dell’autonomia e dell’interazione umana

L’azienda di robotica Figure ha presentato il suo robot umanoide di seconda generazione. Figure 02 porta i robot autonomi a nuovi livelli. Si tratta di un robot di 1,65 m, del peso di 70 kg, dotato di potenti aggiornamenti hardware, avanzate capacità di intelligenza artificiale e operazioni simili a quelle umane in diversi contesti.

Come riportato qui, la capacità di Figure 02 di partecipare a conversazioni in linguaggio naturale è una delle sue qualità più notevoli. Il dialogo in linguaggio naturale sviluppato in collaborazione con OpenAI è reso possibile da modelli di intelligenza artificiale personalizzati. Se abbinata agli altoparlanti e ai microfoni integrati, questa tecnologia consente a uomini e robot di comunicare senza problemi. Figure 02 include anche sei telecamere RGB e un modello avanzato di linguaggio visivo per consentire un ragionamento visivo rapido e preciso.

Secondo l’amministratore delegato Brett Adcock, la Figure 02 rappresenta il meglio del loro lavoro di ingegneria e progettazione. La capacità della batteria del robot è aumentata del 50% e la potenza del suo computer è triplicata rispetto al suo predecessore. Il robot può muoversi fino a 1,2 metri al secondo, trasportare carichi utili fino a 20 kg e funzionare per cinque ore con una sola carica.

BMW Manufacturing ha già condotto dei test su Figure 02. Ha dimostrato il suo potenziale nelle applicazioni pratiche gestendo da solo le attività di raccolta dati e di addestramento dell’intelligenza artificiale. L’obiettivo più ampio di questi esperimenti è quello di utilizzare i robot umanoidi per aumentare l’efficienza e la produzione in diversi settori industriali.

Le principali aziende tecnologiche hanno sostenuto il finanziamento dell’azienda per un valore di 675 milioni di dollari. Questi fondi provengono da aziende tecnologiche come Intel Capital, Nvidia, Microsoft e Amazon. Ciò indica un alto livello di sostegno del settore agli obiettivi di Figure. Nonostante i risultati raggiunti, Figure si trova ad affrontare la concorrenza agguerrita dei principali concorrenti sul mercato, tra cui 1X, Boston Dynamics, Tesla e Apptronik.

Lo sviluppo di questa tecnologia solleva questioni importanti riguardanti l’interazione uomo-robot, il futuro del lavoro e le implicazioni morali di macchine sempre più intelligenti e autonome. La Figure 02 è un grande traguardo, ma sottolinea anche la necessità di continuare a discutere i modi migliori per incorporare le nuove tecnologie nella società in modo che vadano a beneficio di tutte le persone. [...]