Il team di Facebook A.I. sta sviluppando una funzionalità tattile per i futuri robot

La Meta Platforms Inc. (ex Facebook) consentirà ai robot di percepire il tatto, grazie a due nuovi sensori di loro creazione, ma l’idea non è limitata ai robot, poiché sicuramente il progetto farà forse parte di un livello superiore di realismo destinato anche al metaverso.

Il primo è un sensore ad alta risoluzione chiamato DIGIT, l’altro è una sorta di pelle robotica chiamata ReSkin, che può aiutare l’intelligenza artificiale a distinguere informazioni come la consistenza, il peso, la temperatura e lo stato di un oggetto.

DIGIT

DIGIT consiste in un cuscinetto di silicone simile al gel che ha la forma della punta di un pollice e che si trova in cima a un quadrato di plastica che contiene sensori, una telecamera e luci PCB che rivestono il silicone. Ogni volta che si tocca un oggetto con il gel di silicone, si creano ombre, o cambiamenti di tonalità di colore nell’immagine risultante che viene registrata dalla fotocamera.

Il rilevamento tattile insieme ad altri sensori aiuterà l’I.A. ad avere una percezione più simile a quella umana che può essere utile in una miriade di campi in cui il tocco debba essere più delicato e sicuro quando si maneggiano oggetti, come hanno spiegato i ricercatori di Meta A.I. Roberto Calandra e Mike Lambeta.

Ma prima di tutto, è importante che i sensori possano raccogliere informazioni dalle cose che possono toccare per far sì che l’intelligenza artificiale impari dalla moltitudine di possibili parametri che una superficie può fornire, come le forze di contatto e altre caratteristiche.

A questo proposito, Meta ha reso pubblici i progetti di DIGIT nel 2020, affermando quanto sia facile da costruire, affidabile, a basso costo, compatto e ad alta risoluzione, e ora Meta spera di portare DIGIT al livello successivo collaborando con una startup chiamata GelSight Inc. per commercializzare il sensore, al fine di renderlo maggiormente disponibile ai ricercatori ed accelerarne l’innovazione.

ReSkin

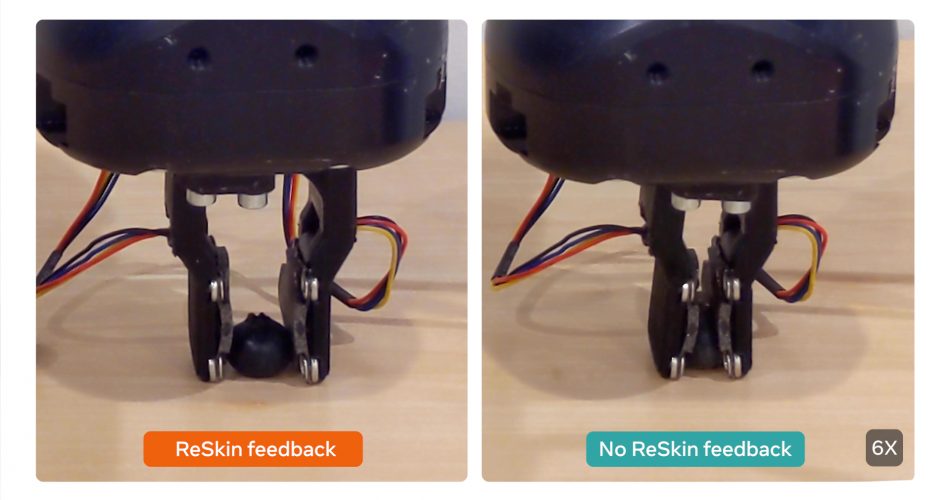

ReSkin, invece è un sensore completamente nuovo che funziona come una pelle sintetica per mani robotiche, utili in una vasta gamma di compiti basati sul tatto, tra cui: la classificazione degli oggetti, la propriocezione e la presa robotica, come hanno scritto i ricercatori di Meta A.I. Abhinav Gupta e Tess Hellebrekers in un post sul blog.

Il rilevamento tattile sarà molto importante dove è richiesta un’alta sensibilità, come nelle strutture sanitarie, o una maggiore destrezza, come con la gestione di piccoli oggetti morbidi o sensibili.

Un aspetto positivo di ReSkin è l’essere estremamente conveniente da produrre, Meta ha dichiarato che 100 pezzi possono essere fatti per meno di 6 dollari, o anche più a buon mercato nel caso di grandi quantità. ReSkin è spesso da 2 a 3 millimetri, ha una durata di 50.000 interazioni, e offre un’alta risoluzione temporale fino a 400Hz e una risoluzione spaziale in mm con una precisione del 90%.

Grazie alle sue specifiche, è perfetto per svariate applicazioni, tra cui: mani robotiche, guanti tattili, maniche per il braccio e persino scarpe per cani. In questo modo, i ricercatori dovrebbero essere in grado di ottenere una vasta gamma di dati tattili che un tempo erano irraggiungibili, o almeno estremamente difficili e costosi da raccogliere. ReSkin offre anche impulsi tattili ad alta frequenza e su tre assi che possono essere utilizzati per fare attività di manipolazione rapida, tra cui: lanciare, scivolare, prendere e battere le mani.

TACTO

Per aiutare la comunità di ricerca, Meta ha creato e reso open-source un simulatore chiamato TACTO che permette la sperimentazione anche in assenza di hardware. I simulatori sono essenziali per l’avanzamento della ricerca sull’intelligenza artificiale nella maggior parte dei campi, perché permettono ai ricercatori di testare e valutare le varie opzioni senza dover effettuare lunghe sperimentazioni nel mondo reale.

“TACTO riesce a rendere realistiche le letture tattili ad alta risoluzione a centinaia di fotogrammi al secondo, e può essere facilmente configurato per simulare diversi sensori tattili basati sulla visione, tra cui DIGIT”, hanno spiegato Calandra e Lambeta.

PyTouch

I ricercatori, d’altra parte, hanno bisogno di un modo per elaborare i dati ed estrarre informazioni. Meta sta contribuendo anche in questo settore, con la creazione di PyTouch, una libreria di modelli di apprendimento automatico che può tradurre i valori del sensore in parametri di alto livello, come il rilevamento dello scivolamento o il riconoscimento del materiale con cui il sensore è venuto a contatto.

PyTouch permette ai ricercatori di addestrare e distribuire modelli su una serie di sensori che forniscono funzionalità di base come: il rilevamento del contatto, lo scivolamento e la previsione della postura dell’oggetto.

L’idea è anche quella di fornire ai ricercatori la possibilità di collegare un sensore DIGIT, scaricare un modello pre-addestrato, e quindi utilizzare questo come blocco di base per la loro applicazione robotica.

Calandra e Lambeta hanno dichiarato che è necessario ulteriore hardware per produrre robot con una sensibilità tattile simile a quella umana, come ad esempio i sensori che possono rilevare la temperatura degli oggetti. Inoltre, bisogna anche che siano in grado di ottenere una migliore comprensione di quali aspetti tattili sono più rilevanti per le varie attività, così come una più profonda comprensione delle architetture computazionali di apprendimento automatico appropriate per il trattamento dei dati tattili.

Questa tecnologia può anche aprire molte possibilità per la realtà aumentata e la realtà virtuale, così come le innovazioni robotiche per il campo industriale, medico e agricolo.

Un ulteriore passo avanti verso la creazione di robot che abbiano capacità sempre più simili a quelle umane, come forse ci eravamo già immaginati tanti anni fa. Resta da capire come la loro parte cerebrale contribuirà a rendere i futuri robot in relazione col mondo circostante.

Fonte siliconangle.com