La ricerca ha analizzato la percezione umana quando le persone sono in contatto con robot simili a quelli umani

Secondo una ricerca dell’American Psychological Association pubblicata sulla rivista Technology, Mind, and Behavior, e qui riportata, la nostra tendenza a umanizzare i robot, soprattutto quelli che si relazionano con le persone mostrando emozioni simili a quelle umane, può indurci a pensare che siano in grado di pensare da soli piuttosto che agire come risposta a un programma.

“La relazione tra la forma antropomorfa, il comportamento simile a quello umano e la tendenza ad attribuire ai robot un pensiero indipendente e un comportamento intenzionale non è ancora stata compresa”, ha dichiarato l’autrice dello studio Agnieszka Wykowska, ricercatrice principale presso l’Istituto Italiano di Tecnologia.

“Poiché l’intelligenza artificiale fa sempre più parte della nostra vita, è importante capire come l’interazione con un robot che mostra comportamenti simili a quelli umani possa indurre una maggiore probabilità di attribuire al robot una capacità di azione intenzionale”.

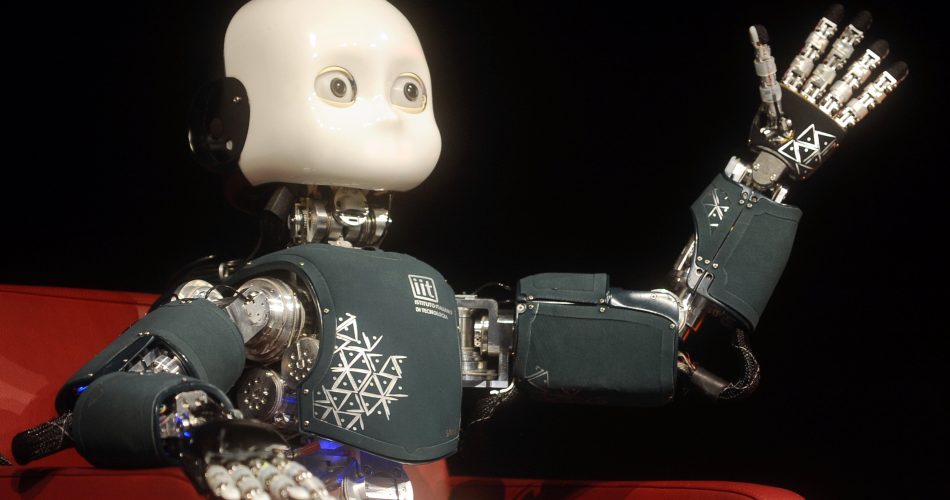

L’iCub è un robot umanoide che è stato utilizzato in tre prove con 119 partecipanti per vedere come le persone avrebbero reagito dopo aver interagito con esso e guardato film insieme.

Il robot umanoide a misura di bambino, chiamato iCub, è stato costruito in Italia e ha la capacità di afferrare oggetti, gattonare e comunicare con gli esseri umani. È destinato a servire come piattaforma open-source per la ricerca in robotica, intelligenza artificiale e scienze cognitive.

I partecipanti hanno risposto a domande che mostravano foto del robot in vari scenari ed è stato chiesto loro di scegliere se ritenevano che lo scopo di ogni scenario fosse meccanico o intenzionale prima e dopo aver interagito con il robot.

Nei primi due test, i ricercatori hanno controllato a distanza il comportamento di iCub in modo che agisse in modo naturale, presentandosi, salutando gli individui e chiedendo i loro nomi. Gli occhi del robot erano dotati di telecamere in grado di rilevare i volti dei partecipanti e di mantenere il contatto visivo. I partecipanti hanno poi visto tre brevi documentari con il robot, che è stato progettato per emettere suoni e mostrare espressioni facciali di tristezza, stupore o gioia in risposta ai video.

Nel terzo esperimento, i ricercatori hanno fatto vedere a iCub dei filmati insieme ai soggetti, mentre gli veniva insegnato a comportarsi più come una macchina. Il robot non poteva mantenere il contatto visivo, poiché le telecamere nei suoi occhi erano spente, e parlava ai partecipanti solo con battute registrate riguardanti la procedura di calibrazione che stava eseguendo. Il suo busto, la testa e il collo si muovevano ripetutamente emettendo un “bip”, sostituendo qualsiasi risposta emotiva ai video.

I ricercatori hanno scoperto che i partecipanti che hanno avuto a che fare sia con il robot simile a un essere umano sia con il robot simile a una macchina avevano maggiori probabilità di percepire le attività del robot come intenzionali e non programmate. Questo dimostra che le persone non danno automaticamente per scontato che un robot che assomiglia a un essere umano abbia la capacità di pensare e sentire. È possibile che un comportamento simile a quello umano sia essenziale per essere presi sul serio come agenti intenzionali.

Questi risultati, secondo Wykowska, suggeriscono che quando l’intelligenza artificiale dà l’impressione di imitare il comportamento umano, le persone possono essere più propense a ritenere che sia in grado di pensare in modo indipendente. L’autrice suggerisce che questo potrebbe influenzare la progettazione di robot sociali in futuro.

“Il legame sociale con i robot potrebbe essere vantaggioso in alcuni contesti, come nel caso dei robot di assistenza sociale. Per esempio, nell’assistenza agli anziani, il legame sociale con i robot potrebbe indurre un maggior grado di conformità rispetto alle raccomandazioni sull’assunzione di farmaci”, ha affermato Wykowska.

“Determinare i contesti in cui il legame sociale e l’attribuzione di intenzionalità sono utili per il benessere degli esseri umani è il prossimo passo della ricerca in questo settore”.

Sebbene i robot simili agli esseri umani possano sembrare una soluzione per coinvolgere le persone che hanno bisogno di assistenza sociale, questo potrebbe portare a intenzioni manipolatorie per ingannare le persone. Quindi la domanda è: un robot non umano può essere utile come un robot umano, ma con meno rischi?